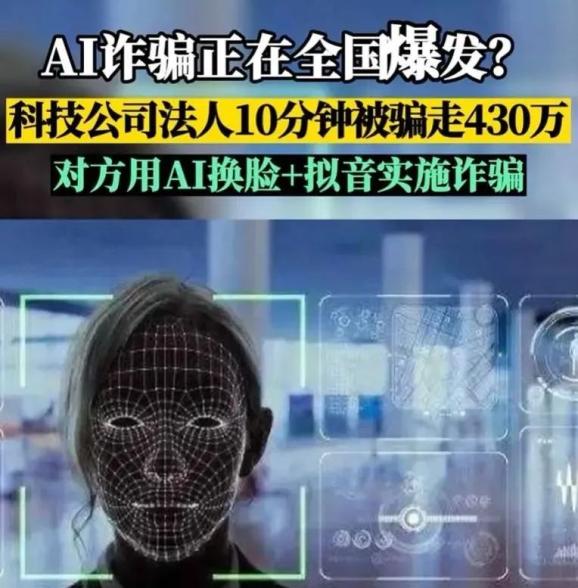

欧博allbetAI诈骗多地频发,70%的人分不清AI克隆声音

防骗每日电讯 2025年03月27日 00:39 河南

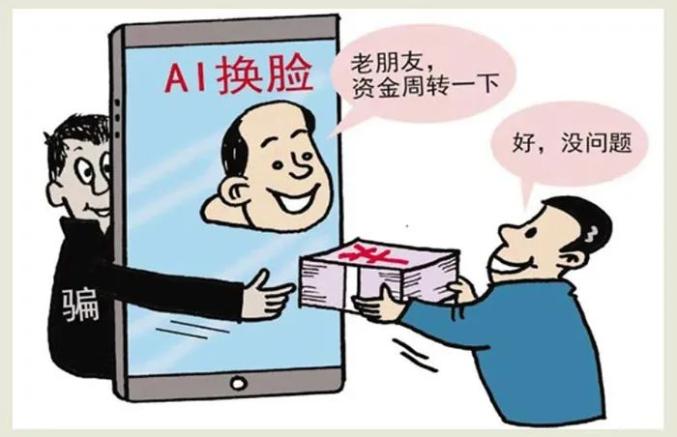

随着智能AI的兴起

连带换脸换声技术也越来越发达

从雷军被AI换声吐槽假期

到普通人被10秒AI视频诈骗

本是科技进步璀璨结晶的AI技术

如今却成为诈骗分子作恶的手段

“30秒的音频就可以帮你克隆声音”

“24小时内合成相似度高达90%音频”

社交平台也随处可见的几秒换脸应用

价格低廉,欧博allbet作品却没有任何提示和标记

足以“以假乱真”

真实案例一

小李的“大学同学”通过QQ跟她借钱。为了打消小李的顾虑,对方还打来一段四五秒的视频电话,小李见视频中的人确实是“同学”本人,便放心地给对方转了3000元。

然而,没过多久“同学”又提出了借钱的请求,就在小李准备第二次转账时,她察觉到了异常,便给对方打了电话,这才发现同学的账号被盗,和自己视频通话借钱的并不是同学,于是马上报警。

真实案例二

张先生在外面办事时,网名“一帆风顺”的陌生人添加其微信。对方告知,自己是张先生公司的负责人陈总,这会临时办点私事,不太方便接电话,才用微信小号加了他的微信,要他取10万元现金送到公司楼下,自己办完私事会尽快归还。正当张先生感到疑惑时,他接到了“陈总”打来的视频电话。接通后,张先生看到手机里的“陈总”正坐在一间会议室里,没有说话,10秒钟后,视频电话被对方挂断。尽管对方未发一言,但看到对方的相貌神态与自己的领导完全一样,张先生还是按照对方发来的信息,将10万元转到了相应账户。

谁知,回到单位后,张先生得知陈总上午一直在自己的办公室没有出去,遂赶紧找陈总询问,对方表示自己并没有给他发过相关信息。张先生这才意识到自己被骗了,于是赶紧报案。

重点受骗人群

留学生家长及老年人群体

70%的人分不清AI克隆声音,有留学生家长接到“孩子被绑架”的求救电话,听到哭声和喘气声跟自家孩子一模一样,结果慌忙转账后才知是AI合成。骗子甚至能通过社交平台3秒语音,克隆出85%相似度的声音。

第一,选择可信平台,不要随意下载未经官方认证的App,即便其提供免费通话或其他看似诱人的功能,也可能暗藏陷阱。

第二,可要求对方做快速转头、用手遮脸等即兴动作,看反应是否自然,AI生成内容易出现面部扭曲或延迟,或者要求对方回答只有你们知晓的问题。

第三,涉及转账时,通过电话、线下见面等多途径确认对方是否为本人。在无法确认对方身份时,应避免转账操作。

第四,建立“多因子身份认证”机制,类似于旧时的“暗号”机制,在关键对话前设定只有双方知晓的隐秘认证方式。你们可以事先约定一个特殊问题,只有对方能正确回答,在感觉有异样时便可以使用。

原标题:《防诈小课堂 | AI诈骗多地频发,70%的人分不清AI克隆声音》